Reverse engineering top 3 to proces rozkladania trzech najlepszych wynikow Google na sygnaly rankingowe, ktore mozna skopiowac lub pobic. W 2026 roku to nie jest analiza meta tagow – to audyt intencji, glebi tematycznej, struktury danych, linkow i sygnalow behawioralnych, ktory konczy sie arkuszem decyzji i 30-dniowym planem wdrozenia.

W skrocie

- Reverse engineering top 3 to systematyczny audyt 3 najlepszych URL-i dla zapytania, obejmujacy 7 warstw sygnalow.

- Sama dlugosc tekstu i liczba slow kluczowych to ~15% obrazu – reszta to intencja, struktura, linki, dane, UX.

- Najskuteczniejsza metoda to tabela porownawcza wszystkich 3 URL-i z oznaczeniem wspolnych wzorcow.

- Wspolne cechy top 3 to must-have, unikalne cechy lidera to potencjalna przewaga konkurencyjna.

- Audyt konczy sie priorytetyzacja 5-10 poprawek oraz planem wdrozenia w oknie 30 dni.

Czym jest reverse engineering top 3 i po co go robic

Reverse engineering top 3 to metoda planowania tresci i SEO, w ktorej traktujemy algorytm Google jako czarna skrzynke, a wyniki na pierwszych trzech pozycjach jako gotowa odpowiedz, co dany algorytm uwaza za najlepsze dla konkretnego zapytania. Zamiast zgadywac, analizujemy, co konkretnie laczy tych zwyciezcow i jakie sa ich wspolne cechy mierzalne.

Google aktualizuje setki sygnalow rankingowych kwartalnie, ale jedno sie nie zmienia – jesli 3 URL-e utrzymuja sie w top 3 przez 90 dni, to spelniaja wszystkie aktualnie wazne sygnaly dla tego zapytania. Kopiowanie ich wspolnych cech to najnizsze ryzyko w SEO. Pelny kontekst tej metody opisujemy w przewodniku po SEO zaawansowanym.

Metoda ma dwa zastosowania. Pierwsze – planowanie nowej tresci, gdzie zaczynamy od zera i chcemy zminimalizowac ryzyko chybionej intencji. Drugie – audyt istniejacego artykulu, ktory nie rankuje, gdzie porownujemy go z top 3 i szukamy luk. Oba zastosowania korzystaja z tej samej metodyki, ale z innym nastawieniem – w pierwszym budujemy od zera, w drugim diagnozujemy.

Trzecie zastosowanie, rzadziej uzywane, to weryfikacja podejrzenia, ze dane zapytanie jest „nieuczciwe” – zdominowane przez konkretne marki w sposob, ktorego nie da sie przebic. Reverse engineering pokazuje, czy przewaga top 3 wynika ze skopiowanych sygnalow, czy z niedostepnych dla nas atutow (autorytet marki, wiek domeny, linki z wielkich publikacji).

Kiedy reverse engineering dziala a kiedy nie

Metoda dziala dla 70-80% zapytan komercyjnych i informacyjnych. Dziala szczegolnie dobrze dla tematow dojrzalych, gdzie top 3 stabilizuje sie przez lata. Dla tych zapytan sygnaly sa wystarczajaco silne, by kopiowanie dzialalo.

Metoda zawodzi w trzech przypadkach. Pierwszy – zapytania YMYL (medycyna, finanse), gdzie autorytet marki dominuje nad wszystkim innym. Drugi – zapytania brand + keyword, gdzie Google faworyzuje konkretna marke. Trzeci – zapytania bardzo nowe, gdzie top 3 co tydzien sie zmienia.

Test zanim zaczniemy – sprawdzamy stabilnosc top 3 w Ahrefs Position History z ostatnich 90 dni. Jesli URL-e sa na podium caly czas, metoda bedzie niezawodna. Jesli widac rotacje i pozycje 1-5 graja w muzyczne krzesla, sygnaly sa zaszumione i lepiej poczekac.

Jakie sygnaly zbieramy – 7 warstw audytu

Kompletny reverse engineering obejmuje 7 warstw, zbieranych jednoczesnie. Kazda warstwa odpowiada na inne pytanie o to, co algorytm premiuje. Pominiecie jakiejkolwiek warstwy daje niekompletny obraz.

- Warstwa intencji – czy strona odpowiada na pytanie informacyjne, nawigacyjne, transakcyjne czy komercyjne.

- Warstwa tresci – liczba slow, glebokosc podtematow, dlugosc akapitow, struktura H2/H3.

- Warstwa encji i semantyki – jakie byty (osoby, firmy, produkty, koncepcje) sa wymienione.

- Warstwa techniczna – czas ladowania, CWV, schema, dane strukturalne, dostepnosc.

- Warstwa linkow – profil backlinkow, wewnetrzne podlinkowanie, anchor text.

- Warstwa UX i SERP – rich snippets, favicon, breadcrumbs, sitelinks, AI overview.

- Warstwa behawioralna – CTR z SERP, czas na stronie, pogo-sticking (przyblizony z narzedzi zewnetrznych).

Klasyczny blad to skupienie sie tylko na warstwie tresci i ignorowanie warstwy linkow, co prowadzi do pisania doskonalych artykulow, ktore i tak nie rankuja. Drugi czesty blad – pomijanie warstwy behawioralnej, bo trudno zmierzyc. Narzedzia typu Similarweb, mimo niedoskonalosci, daja lepsze pojecie niz nic.

Kazda warstwa ma wage, ktora zalezy od typu zapytania. Dla informacyjnych – dominuje tresc i encje (lacznie ~50% wagi). Dla komercyjnych – linki i behawior (~45%). Dla lokalnych – UX, techniczne i SERP features (~40%). Znajomosc tych proporcji pomaga alokowac czas audytu.

Narzedzia do zbierania kazdej warstwy

| Warstwa | Narzedzie podstawowe | Narzedzie uzupelniajace |

|---|---|---|

| Intencja | Rzeczywiste wyniki SERP | Google „People also ask” |

| Tresc | SurferSEO, Clearscope | Reczne liczenie H2/H3 |

| Encje | InLinks, WordLift | Google NLP API |

| Techniczne | PageSpeed Insights, Schema validator | Chrome DevTools |

| Linki | Ahrefs, Majestic | Semrush Backlinks |

| UX/SERP | SERP screenshot | SEMrush SERP features |

| Behawior | Similarweb | Ahrefs Keyword Clicks |

Minimum zestaw do sensownego reverse engineeringu to Ahrefs (lub Semrush) + SurferSEO + Chrome DevTools. Bez nich analiza staje sie zgadywaniem. Pelna liste narzedzi pomocniczych zbieramy w przegladzie narzedzi SEO na 2026.

Dla mniejszych budzetow istnieja alternatywy. Semrush i Ahrefs maja darmowe limitowane konta dajace podglad kilku zapytan dziennie. SurferSEO ma substytut w postaci Surfer SEO Chrome Extension. Google Search Central Page Speed API i Lighthouse sa w pelni darmowe i wystarczaja do warstwy technicznej.

Jak wyglada arkusz analizy – szablon

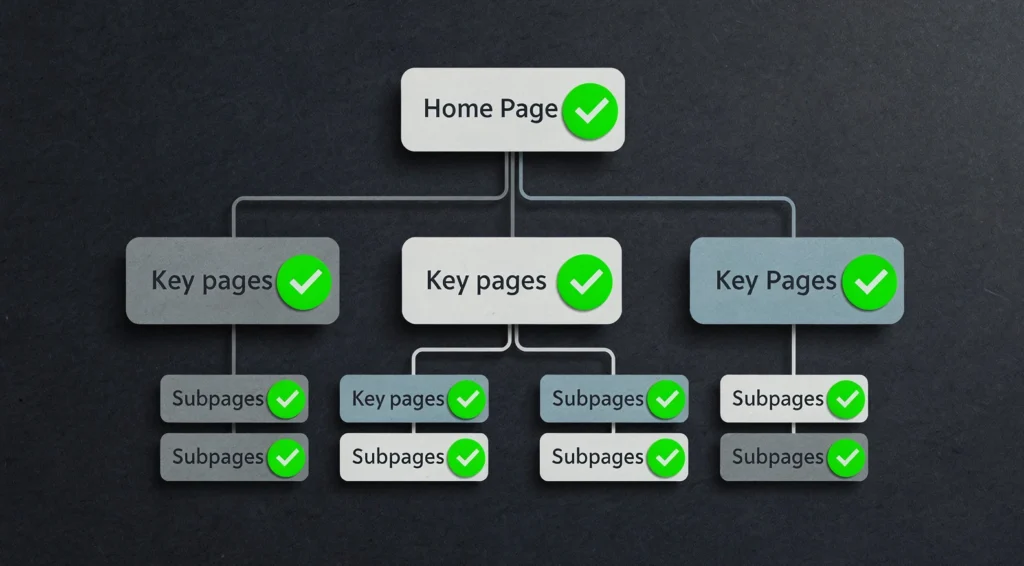

Wszystkie zebrane dane trafiaja do jednego arkusza z trzema kolumnami URL-i i wierszami sygnalow. Dopiero taki format pokazuje wzorce, ktore gubia sie w rozproszonych notatkach. Arkusz ma okolo 40-50 wierszy i pelni role jedynego zrodla prawdy przez caly proces audytu.

Kluczowe wiersze to: URL, tytul, meta, liczba slow, liczba H2, liczba H3, liczba obrazow, liczba tabel, liczba list, obecnosc FAQ, obecnosc schema, typ schema, czas ladowania, LCP, CLS, liczba domen linkujacych, liczba backlinkow, DR, TF, wiek domeny, wiek URL, aktualizacja, autor, obecnosc E-E-A-T sygnalow, rich snippets, AI overview.

Dodatkowo 15-20 wierszy dla pokrycia podtematow: czy artykul omawia temat A, B, C, D, itd. To daje obraz, ktore podtematy sa wspolne dla top 3, a ktore unikalne dla jednego z URL-i. Ta czesc jest najbardziej pracochlonna, bo wymaga dokladnego przeczytania kazdego z 3 URL-i i zmapowania spisu tresci na standardowa liste podtematow.

Jak oznaczac wzorce

Po wypelnieniu arkusza dodajemy kolumne „wzorzec” z trzema wartosciami: wspolne (wszystkie 3 URL-e maja), lider (tylko #1 ma), rozproszone (1-2 URL-e maja). Wspolne cechy to baza – bez nich nie ma szans na top 3.

Cechy „lider” to dwie interpretacje. Pierwsza – to cos, co dalo mu przewage i warto skopiowac. Druga – to cos niezwiazanego z rankingiem, co by tak bylo. Rozstrzygamy przez sprawdzenie, czy cecha pasuje do intencji zapytania. Jesli tak – kopiujemy. Jesli nie – prawdopodobnie to szum, a nie sygnal.

Jak obsluzyc warstwe pokrycia podtematow

Ta czesc arkusza wyglada jak macierz – wiersze to podtematy, kolumny to URL-e, komorki to 0/1 (brak/jest). Po wypelnieniu widac natychmiast, ktore podtematy sa uniwersalne (3 jedynki w wierszu) i ktorych nam brakuje. Do podtematow dodajemy tez liczbe slow poswieconych kazdemu – glebokosc ma znaczenie.

Jak analizowac warstwe intencji

Intencja to warstwa numer jeden, bo jesli sie pomylimy, wszystkie inne analizy sa bezuzyteczne. Zrobienie idealnego artykulu „jak” na zapytanie transakcyjne nie zadziala – Google chce widziec sklep, nie poradnik.

Klasyfikacja jest prosta. Patrzymy na top 3 i pytamy: czy to sa sklepy, poradniki, narzedzia, porownania, definicje, listy, wiadomosci. Jesli wszystkie 3 sa tego samego typu, intencja jest jasna. Jesli sa mieszane, zapytanie ma niejednoznaczna intencje i lepiej wybrac inne albo dostosowac forme hybrydowa.

Sygnaly wspomagajace to SERP features. Map pack = lokalna. Shopping carousel = transakcyjna. Featured snippet = informacyjna. Video carousel = instrukcyjna. AI overview = definicyjna z potrzeba syntezy. To metoda z pelnej analizy konkurencji.

Jak rozroznic intencje poboczne

Niektore zapytania maja intencje glowna i poboczna, czesto widoczna w Google Related Searches. Dobra tresc odpowiada na obie – ale tylko jesli nie rozbija struktury. Przyklad: zapytanie „crawl budget” ma intencje informacyjna, ale pobocznie „narzedzia do crawl budget”.

Rozwiazanie – jeden artykul glowny na intencje glowna, jedna sekcja o narzedziach (ale bez robienia z niej polowy tekstu). Pelne rozbicie w tekscie o audycie crawl budget.

Test intencji w 3 krokach

Krok 1 – kopiujemy tytuly top 10 i szukamy wzorca (np. „jak”, „najlepsze”, „X vs Y”). Krok 2 – patrzymy na typy snippetow i zastanawiamy sie, dlaczego Google wybral taki format. Krok 3 – wkleic nasz planowany tytul do listy top 10 i oceniamy, czy nie odstaje. Jesli tak – zmieniamy tytul, nie tresc.

Jak analizowac warstwe tresci

Analiza tresci to nie tylko liczba slow. Kluczowe metryki to: dlugosc, glebokosc podtematow, struktura naglowkow, formaty (tabele, listy, obrazy), dlugosc akapitow, obecnosc sekcji specjalnych (FAQ, TL;DR).

Liczba slow to wartosc referencyjna, nie docelowa. Jesli top 3 ma 3000-3500-3200 slow, celujemy w 3500-4000, nie w 8000. Przekroczenie dlugosci nie daje przewagi – daje ryzyko rozwodnienia tematu. Jesli topowy wynik ma 5000 slow, a reszta 2000, to sygnal, ze dlugosc nie byla czynnikiem decydujacym.

Glebokosc podtematow – analiza H2/H3

Zbieramy wszystkie H2 i H3 z top 3 w jedna liste. Podtematy wymienione 3 razy to must-have. Wymienione 2 razy to should-have. Wymienione raz to opcjonalne.

Dobra praktyka – zamienic te liste w wireframe artykulu. Dla 10 must-have + 5 should-have + 3 opcjonalne mamy ~18 sekcji H2/H3, co prowadzi do 3500-4500 slow bez problemu. Tak powstaje szkielet, ktory jest juz lepszy od kazdego z trzech zrodel.

Formaty – co wybiera Google

Liczymy: tabele, listy numerowane, listy wypunktowane, obrazy, wykresy, kod, cytaty. Jesli wszystkie 3 URL-e maja 5+ list i 2+ tabele, to sygnal, ze format listy/tabeli jest premiowany dla tego zapytania. Nasz artykul musi miec wiecej niz srednia, inaczej bedzie gorzej parsowalny.

Dlugosc akapitow i czytelnosc

Mierzymy srednia dlugosc akapitu w top 3. Jesli akapity sa 2-3 zdaniowe, piszemy tak samo. Jesli maja 5-6 zdan, akapity dluzsze sa ok. Zmienne niewidoczne na pierwszy rzut oka – Flesch Reading Ease, srednia dlugosc zdania, liczba trudnych slow – daja sie mierzyc w ciagu 5 minut i pomagaja kopiowac styl.

Jak analizowac warstwe linkow

Linki to druga co do waznosci warstwa po intencji. Jesli top 3 ma srednio 150 domen linkujacych, a my 5, mamy ogromna gore do pokonania. Analiza musi odpowiedziec: ile linkow, z jakich domen, z jakimi anchorami, w jakim tempie pozyskiwanych.

| Metryka | Minimum do top 3 | Komentarz |

|---|---|---|

| Domeny linkujace (RD) | 50-80% sredniej top 3 | Sila sumaryczna |

| Linki ogolem (BL) | 30-50% sredniej top 3 | Mniej wazne niz RD |

| Anchor text brand | 40-60% | Naturalnosc profilu |

| Anchor text exact | max 10% | Wieksze grozi spamem |

| Tempo wzrostu RD | 5-15% miesiecznie | Gwaltowne skoki sa podejrzane |

Zawsze sprawdzamy takze, z jakich tematow przychodza linki. Jesli top 3 ma 60% linkow z branzy tech, a my mamy 90% z blogow lifestylowych, to sygnal, ze topical relevance linkow jest mocniejszym sygnalem niz liczba.

Ktore linki maja najwiekszy wplyw

Filtrujemy RD top 3 po wskaznikach DR/TF. Linki z DR 70+ daja ~10x wieksza sile niz linki z DR 20-40. Skupiamy sie na pozyskaniu tego samego typu linkow, bo one faktycznie robia roznice. Wiecej o tym w pelnym przewodniku po autorytecie.

Wewnetrzne linkowanie top 3

Drugi, czesto niezauwazany aspekt to jak top 3 jest podlinkowany wewnatrz wlasnej domeny. Strony z 20-50 wewnetrznymi linkami przychodzacymi rankuja lepiej niz te z 2-3. Crawl top 3 narzedziem typu Screaming Frog pokazuje graf linkowania i to jest wskazowka, jak rozbudowac naszego interlinka.

Jak analizowac warstwe techniczna i UX

Warstwa techniczna dla top 3 w 2026 jest zwykle solidna – slabe technicznie strony rzadko rankuja wysoko. Dlatego zamiast szukac luk, sprawdzamy wspolne wymagania minimum.

Wymagane minimum dla top 3 w 2026 to: LCP pod 2.5s, CLS pod 0.1, INP pod 200ms, responsywnosc mobilna, HTTPS, czyste dane strukturalne (Article/BlogPosting/FAQPage/HowTo w zaleznosci od typu).

Schema.org jest rzadko unikalnym czynnikiem rankingowym, ale jest warunkiem rich snippets, a te wplywaja na CTR. Dlatego kopiujemy typy schema z top 3. Google oficjalnie opisuje implementacje danych strukturalnych (wiecej w dokumentacji Google Search Central).

AI overview i inne SERP features

Dla ok. 30% zapytan w 2026 roku pojawia sie AI overview. Jesli top 3 jest tam cytowane, to sygnal, ze tresc jest latwo parsowalna dla LLM. Sprawdzamy, jak sa cytowane – ktory fragment jest wybrany, jak dlugi, z jakiej sekcji.

Strategia – dodajemy do artykulu sekcje typu „co to jest X” z 2-3 zdaniowa definicja na poczatku. Takie sekcje sa najczesciej cytowane przez AI overview i Perplexity. Pelna metodologia opisana w przewodniku o widocznosci w AI.

Favicon, breadcrumbs i sitelinks

Drobiazgi, ktore wplywaja na CTR. Favicon musi byc 32×32 px, kwadratowa, na czystym tle. Breadcrumbs wymagaja BreadcrumbList schema i poprawnej struktury URL. Sitelinks pojawiaja sie automatycznie, gdy zapytanie jest brandowe i strona ma solidna strukture wewnetrznych linkow i nawigacji.

Jak z analizy przejsc do planu dzialania

Gotowy arkusz to tylko dane. Kluczowy krok to zamiana na priorytetyzowany plan 5-10 akcji, ktore wykonamy w oknie 30 dni. Bez tego kroku audyt lezy i zbiera kurz.

- Wypisz wszystkie luki – elementy wspolne dla top 3, ktorych nie masz.

- Dodaj do kazdej luki koszt (czas, budzet) i spodziewany impact (1-5).

- Posortuj wedlug impact/koszt, zostaw top 10.

- Przypisz termin: 1 tydzien, 2 tygodnie, 30 dni.

- Wyznacz odpowiedzialnego za kazda akcje.

- Zaplanuj rewizje po 30 i 60 dniach (pomiar pozycji i ruchu).

Typowy plan zawiera 2-3 akcje na tresci (dopisanie sekcji, rozbudowa FAQ), 2-3 akcje linkowe (outreach do 20 sajtow), 1-2 techniczne (schema, CWV), 1-2 UX (wewnetrzne linkowanie, format).

Priorytetyzacja akcji – matryca impact/effort

| Impact | Niski effort | Sredni effort | Wysoki effort |

|---|---|---|---|

| Wysoki | Rob od razu | Rob w pierwszej turze | Planuj 60-90 dni |

| Sredni | Rob w drugiej turze | Planuj 30-60 dni | Odlozyc |

| Niski | Planuj 60+ dni | Odlozyc | Nie rob |

Pomiar efektu po 30 i 60 dniach

Po 30 dniach nie oczekujemy skoku na pozycje 1-3, ale widocznego ruchu w gore – z pozycji 15 na 8, z 25 na 14. To sygnal, ze poprawki pracuja. Po 60 dniach jesli nie widzimy zadnego ruchu, wracamy do arkusza i szukamy, co pominelismy. Czesto to warstwa linkow – zbudowanie profilu zajmuje 90-180 dni, a nie 30.

Warstwa encji i semantyki – co kopiowac

Warstwa encji (entities) to byty wymienione w tekscie: osoby, firmy, narzedzia, koncepcje, lokalizacje, daty. Google Natural Language API klasyfikuje wszystkie encje z tekstu i buduje z nich graf semantyczny dla artykulu. Pokrycie encji jest sygnalem glebi tematycznej.

Zbieramy encje z top 3 przez wklejenie URL do Google NLP demo lub InLinks. Dostajemy liste 30-80 encji na artykul. Laczymy listy i zostawiamy encje wystepujace w minimum 2 z 3 URL-i – to zestaw must-have dla naszego artykulu.

Encje typu Organization (firmy: Google, Ahrefs, Semrush) i Person (eksperci cytowani) maja najwyzsza wage. Wspominajac ich w naturalny sposob budujemy mapowanie tematyczne zblizone do top 3. Nie chodzi o sztuczne wciskanie – chodzi o pokazanie, ze poruszamy sie w tym samym ekosystemie konceptualnym.

Pokrycie encji a long-tail

Szeroka mapa encji automatycznie rozszerza ranking na dziesiatki zapytan long-tail. Artykul wspominajacy 50 encji rankuje na duzo wiecej fraz niz ten, ktory wspomina 15. To jeden z powodow, dlaczego dluzsze teksty maja wiecej ruchu – nie dzieki dlugosci, tylko szerszemu pokryciu encji.

Warstwa behawioralna – jak oszacowac

Sygnaly behawioralne to CTR z SERP, czas na stronie, pogo-sticking, bounce rate. Google oficjalnie ich nie ujawnia, ale wewnetrzne dokumenty z Google Leak 2024 potwierdzily, ze Navboost (system behawioralny) jest wazna warstwa rankingu.

Mierzenie zewnetrzne jest przyblizone. Similarweb daje estymacje czasu na stronie i bounce rate dla top 3. Ahrefs Keyword Clicks pokazuje CTR z SERP w sposob modelowany, nie dokladny. Mimo niedoskonalosci te dane pokazuja kierunek – czy top 3 ma wysoki, sredni czy niski engagement.

Akcje wynikajace z tej warstwy to: poprawa pierwszego ekranu (hook w pierwszych 2 sekundach), dodanie tablic tresci dla szybkiej nawigacji, wyraziste H2, krotkie akapity, media. Wszystko, co obniza pogo-sticking i podnosi czas na stronie.

Integracja z pipeline automatyzacji SEO

Reverse engineering top 3 jest manualny z natury, ale czesc kroku 1 (zbieranie danych) da sie zautomatyzowac. Odpytywanie Ahrefs API, SerpAPI, PageSpeed API i parsowanie to standardowy skrypt w Pythonie.

Integracja z pelnym procesem opisana jest w tekscie o pipeline automatyzacji SEO w 8 krokach. Kluczowe jest to, ze automat zbiera dane, a czlowiek robi synteza i decyzje – tych drugich nie da sie latwo zautomatyzowac.

Typowy pipeline wyglada tak: skrypt zbiera 7 warstw danych do arkusza (15 minut), analityk analizuje i dodaje komentarze (60-90 minut), zespol ustala plan dzialania (30 minut). Lacznie 2 godziny zamiast 6, z jakoscia tej samej lub wyzsza.

Najczestsze bledy w reverse engineeringu

Pierwszy blad – analiza tylko #1. Jeden URL to anegdota, 3 to wzorzec. Bez porownania wszystkich 3 nie da sie odroznic sygnalu od szumu.

Drugi blad – kopiowanie slepe. Kopiujemy wspolne cechy intencji, struktury i formatow, ale nie kopiujemy sposobu wyrazania – to grozi oskarzeniem o plagiat i spada jakosc unikalnosci.

Trzeci blad – ignorowanie warstwy linkow. Mozna miec idealna tresc, ale bez linkow nie przebije sie przez konkurencje z 200 RD. Zawsze sprawdzamy, czy walka o top 3 jest realna z naszym profilem linkowym.

Czwarty blad – brak aktualizacji arkusza. SERP sie zmienia. Arkusz sprzed 6 miesiecy moze byc nieaktualny, bo do top 3 weszla nowa strona. Rewizja co kwartal to minimum.

Piaty blad – pomijanie warstwy behawioralnej. Nawet jesli tresc idealnie odwzorowuje top 3, wysoki pogo-sticking zabija pozycje. Sprawdzamy, czy nasza strona utrzymuje uwage na poziomie zblizonym do top 3.

Szosty blad – analiza bez stabilnosci. Jesli top 3 zmieniaja sie co tydzien, to nie sa to stabilne wzorce, tylko eksperyment Google. Wstrzymujemy audyt i czekamy 2-4 tygodnie, az SERP sie ustabilizuje.

Siodmy blad – nieczytanie calych tekstow. Skanowanie tylko naglowkow H2 pomija sygnaly ukryte w akapitach (definicje, przyklady, konkretyzacje). Zawsze przeczytaj top 3 w calosci, z notatkami.

FAQ – najczestsze pytania

Czym rozni sie reverse engineering top 3 od zwyklej analizy konkurencji?

Zwykla analiza konkurencji patrzy szeroko na rynek i ocenia graczy po wskaznikach marki. Reverse engineering top 3 jest wasko skoncentrowany na jednym zapytaniu i trzech konkretnych URL-ach, ktore rankuja na nie dzisiaj. Cel rowniez jest inny – zwykla analiza odpowiada „kim sa konkurenci”, reverse engineering odpowiada „co konkretnie muszimy zrobic, zeby wejsc do top 3 dla tego slowa”. To bardziej taktyczne, mniej strategiczne.

Ile czasu zajmuje pelen reverse engineering jednego zapytania?

Dla doswiadczonego analityka SEO pelny audyt 3 URL-i przez 7 warstw to 4-6 godzin. Najwiecej czasu zajmuje warstwa tresci (2-3 godziny na zmapowanie struktury H2/H3 i pokrycia podtematow) oraz warstwa linkow (1-2 godziny na profil backlinkow). Reszte warstw da sie zrobic w 30-45 minut kazda. Proces da sie skrocic do 2 godzin z automatyzacja zbierania danych, ale synteza i plan dzialania nadal wymagaja czlowieka.

Czy warto robic reverse engineering dla kazdego artykulu?

Nie. Pelny reverse engineering to inwestycja 4-6 godzin, wiec rob go tylko dla artykulow o duzym potencjale ruchu (1000+ miesiecznych wyszukan) lub wysokiej wartosci komercyjnej. Dla dlugiego ogona (300 wyszukan i mniej) wystarczy skrocona wersja – tylko warstwa intencji, tresci i formatu. To 30-45 minut i daje 70% efektu pelnej analizy. Dla pillar posts i glownych artykulow komercyjnych zawsze pelna wersja.

Jak czesto aktualizowac arkusz analizy?

Dla stabilnych zapytan informacyjnych – co 6 miesiecy. Dla zapytan komercyjnych z duza konkurencja – co kwartal. Dla zapytan sezonowych – przed kazdym sezonem. Aktualizacja nie wymaga pelnej analizy od zera – sprawdzamy tylko, czy top 3 sie zmienilo, i jesli tak, uzupelniamy nowego gracza. Jesli top 3 jest stabilne, sprawdzamy tylko, czy liczniki (liczba slow, RD, wiek URL) zmienily sie znaczaco.

Czy narzedzia AI moga zastapic reverse engineering?

Czesciowo. LLM potrafi szybko porownac 3 URL-e pod katem struktury i pokrycia tematu, ale ma trzy slepe punkty. Pierwszy – nie widzi warstwy linkow, bo nie ma dostepu do Ahrefs API bez integracji. Drugi – nie widzi warstwy behawioralnej i SERP features. Trzeci – nie rozrozni dobrego od zlego wyboru przy ambiwalentnej intencji. Dobry proces to LLM do szybkiej syntezy tresci + czlowiek do warstw reszty + narzedzia SEO do danych twardych.

Co zrobic, jesli top 3 jest zdominowane przez marki, ktorych nie przebije?

Gdy top 3 to Wikipedia, Forbes i strona rzadowa, szansa na wejscie z nowej domeny w 6-12 miesiecy jest bliska zeru. Trzy opcje. Pierwsza – zmienic zapytanie na dluzsze i mniej konkurencyjne, gdzie dominacja brandow jest slabsza. Druga – celowac w pozycje 4-10, skad ruch wciaz jest sensowny (15-25% calosci). Trzecia – budowac autorytet domeny na okolo w 12-24 miesiecy, co bywa oplacalne tylko dla zapytan z wysokim CPC. Najczesciej najlepsza decyzja to przejscie do long-tail.

Czy reverse engineering dziala dla wyszukiwarek AI (Perplexity, ChatGPT)?

Metoda dziala, ale z modyfikacjami. W wyszukiwarkach AI nie ma klasycznego top 3 – jest lista cytowan, ktora moze zawierac 5-20 zrodel. Analizujemy wspolne cechy cytowanych tekstow: format (czesto listy i definicje), dlugosc fragmentu cytowanego, obecnosc konkretnych faktow. Inne wyszukiwarki AI porownujemy w przegladzie silnikow AI. Klasyczny reverse engineering i AI-owy to dwa osobne audyty, ktore warto robic razem.

Jak mierzyc impact poprawek z audytu?

Trzy wskazniki, ktore pozwalaja zmierzyc efekt w 30-90 dniach. Pierwszy – pozycja dla zapytania glownego (z Ahrefs lub Semrush Position Tracking). Drugi – ruch organiczny z Google Search Console na ten konkretny URL. Trzeci – liczba zapytan dlugiego ogona, na ktore strona zaczela rankowac. Wzrost pozycji bez wzrostu ruchu oznacza, ze weszlismy na zapytanie o niskiej objetosci. Wzrost ruchu bez wzrostu pozycji oznacza, ze weszlismy na nowe dlugie ogony. Idealny wynik – oba wskazniki rosna rownolegle.

Co dalej

Zacznij od wyboru 3 zapytan o najwiekszej wartosci komercyjnej i zrob dla nich pelna analize – to fundament do strategicznego planowania. Kolejny krok to budowa topical authority, czyli systematyczne pokrywanie calego klastra tematycznego, co rozbijamy na konkretne dzialania w tekscie o budowaniu topical map. Po zebraniu danych z top 3 dla kilku zapytan warto spojrzec na case study programmatic SEO, ktore pokazuje jak skalowac wnioski na tysiace stron.