Marka w AI to nie to samo, co marka w Google. Modele jezykowe nie indeksuja stron, lecz buduja wewnetrzna mape jednostek (tzw. entity), na ktora skladaja sie nazwy, atrybuty i relacje. Jesli Twoja marka jest dla LLM rozpoznawalna jednostka, pojawi sie w odpowiedziach ChatGPT, Perplexity i Gemini. Jesli nie, model po prostu o niej nie wspomni, nawet gdy zapytanie idealnie pasuje do oferty. W tym przewodniku pokazuje, jak zaprojektowac marke jako entity, ktora LLM zna, cytuje i poleca w 2026 roku.

Artykul jest praktycznym uzupelnieniem materialu o cytowaniach marek w odpowiedziach AI. Tam pokazujemy, co dzieje sie, gdy entity juz dziala. Tutaj koncentrujemy sie na fundamentach: jak zbudowac jednostke od zera i utrzymac ja w pamieci modeli przez kolejne kwartaly.

Czym jest marka jako entity w AI

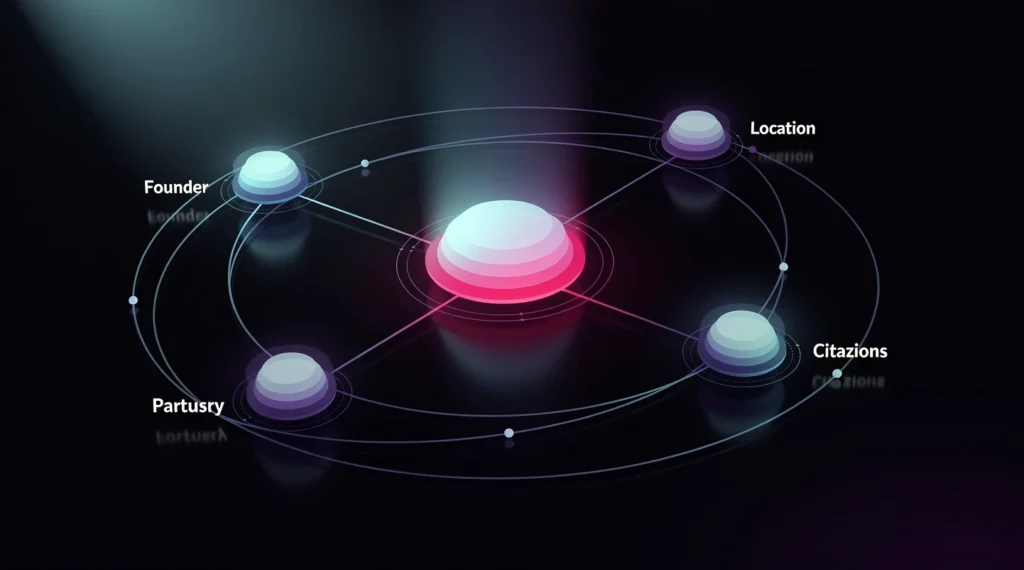

W klasycznym SEO marka byla zbiorem stron, linkow zwrotnych i sygnalow zaufania w grafie Google. W generatywnym wyszukiwaniu jest punktem na grafie wiedzy modelu jezykowego. Entity to wezel, ktory posiada wlasna nazwe kanoniczna, zestaw atrybutow (kategoria, branza, kraj, zalozyciel, rok powstania, oferta, dane kontaktowe) oraz krawedzie laczace go z innymi wezlami (klienci, partnerzy, autorzy, miejsca, technologie).

Roznica jest fundamentalna. Strona moze byc wysoko w Google i jednoczesnie nie istniec dla ChatGPT, jezeli LLM nie zbudowal jej reprezentacji w trakcie treningu lub w fazie retrieval-augmented generation (RAG). Modele dzialaja na trzech poziomach: parametrycznym (wiedza wbudowana w wagi), kontekstowym (to, co model widzi w oknie zapytania) oraz pobieranym z sieci w czasie rzeczywistym (web retrieval w ChatGPT Search, Perplexity czy Bing Chat). Marka musi byc widoczna na wszystkich trzech, w przeciwnym razie luki w jednym kanale zatruwaja pozostale.

W praktyce oznacza to, ze entity marki jest sprawdzona, jezeli model: (1) potrafi podac jej krotki opis bez halucynacji, (2) wymienia ja spontanicznie przy zapytaniach kategoryjnych („najlepsze agencje SEO w Polsce”), (3) cytuje konkretne dane lub publikacje pod jej nazwa, (4) nie myli jej z konkurencja o podobnej nazwie.

Dlaczego klasyczne sygnaly SEO nie wystarczaja

Linki przychodzace, autorytet domeny i ruch organiczny pomagaja, ale nie sa wystarczajace. LLM ucza sie na duzych, zróznicowanych korpusach (Common Crawl, Wikipedia, ksiazki, fora, dane licencjonowane), w ktorych marka musi pojawiac sie w konkretnych konstrukcjach jezykowych: definicjach, listach, opisach, cytatach branzowych. Sam link bez kontekstu semantycznego nie tworzy entity. Liczy sie wzorzec, w jakim Twoja marka wspolwystepuje z innymi wezlami: kto o niej pisze, w jakich kategoriach, jakimi atrybutami.

Po drugie, modele agreguja informacje. Jezeli na 100 stronach jestes „Adrenaline Motorsport sp. z o.o.”, a na kolejnych 100 „Adrenalina Motorsport”, LLM moze potraktowac to jako dwa rozne podmioty lub jeden o niskim zaufaniu. Spojnosc nazwy kanonicznej jest tu kluczowa, podobnie jak w klasycznym local SEO, tyle ze stawka jest znacznie wyzsza.

Najwazniejsze zasady i framework entity

Po analizie kilkudziesieciu wdrozen widzimy, ze marki, ktore LLM cytuja regularnie, spelniaja siedem warunkow. Traktujemy je jako framework „ENTITY-7”.

Framework ENTITY-7

- Kanoniczna nazwa. Jedna nazwa, jeden zapis, jedna pisownia. Wybierz forme oficjalna, uzywaj jej konsekwentnie w stopkach, opisach, autorach, footerze, profilach branzowych i prasie.

- Definicja. Krotki, neutralny opis w jednym zdaniu (kim jestesmy, co robimy, dla kogo, gdzie). Powtarzaj go w sekcjach „About”, w danych strukturalnych Schema.org Organization, w opisie LinkedIn, na Wikipedii (jezeli sie kwalifikujesz), w katalogach branzowych.

- Atrybuty. Branza, lokalizacja, zalozyciele, rok powstania, oferta, klienci flagowi, technologie. Im wiecej spojnych atrybutow LLM widzi w roznych zrodlach, tym pewniej buduje wezel.

- Relacje. Krawedzie do innych entity: klienci, partnerzy, prasa branzowa, autorzy, wydarzenia, projekty open source. Entity nie zyje w prozni.

- Cytowalnosc. Tresci, ktore mozna zacytowac literalnie: definicje, statystyki, ramki, listy. Modele cytuja krotkie, samonosne fragmenty.

- Dyskoverability. Marka musi byc dostepna w korpusach treningowych i w web retrieval. Oznacza to publikacje w mediach branzowych, profile w Wikipedii lub Wikidata, obecnosc w katalogach branzowych z autorytetem.

- Spojnosc czasowa. Atrybuty zmieniaja sie (oferta, zalozyciele, lokalizacje), wiec aktualizacje musisz rozkladac na wszystkie kanaly w tym samym oknie czasowym, w przeciwnym razie LLM widzi konflikt i obniza zaufanie.

Framework ENTITY-7 jest zgodny z tym, co opisujemy w materiale o monitoringu widocznosci w ChatGPT. Pierwsza weryfikacja, czy framework dziala, polega na regularnym sprawdzaniu, jak modele opisuja Twoja marke bez dodatkowego kontekstu.

Schema.org jako rdzen technicznej reprezentacji

Dane strukturalne Schema.org sa najbardziej oczywistym sygnalem dla wyszukiwarek i wedlug naszych obserwacji takze dla retrieverow, ktore zasilaja LLM. Minimum, ktore zalecamy:

Organizationz polaminame,legalName,alternateName,url,logo,sameAs(LinkedIn, X, Wikidata, branzowe profile),foundingDate,founder,numberOfEmployees,address,contactPoint.Persondla kluczowych autorow i zalozycieli zjobTitle,worksFor,sameAs.WebSitezpublisherodwolujacym sie do Organization, plusSearchAction.ArticleiFAQPagetam, gdzie publikujesz tresc opiniotworcza.

Schema nie jest jedynym kanalem, ale jest kanalem najtanszym i najszybciej skalowalnym. Specyfikacja jest dostepna w oficjalnej dokumentacji Schema.org, a wytyczne dla wyszukiwarek opisuje Google Search Central. Z naszych testow wynika, ze poprawnie wdrozony blok JSON-LD Organization na stronie glownej zwieksza spojnosc, z jaka LLM opisuja firme, juz w okresie 6-8 tygodni po publikacji.

Jak to wdrozyc krok po kroku

Proces budowy entity dzielimy na piec faz. Sekwencja jest istotna: jezeli zaczniesz od PR-u, zanim ustawisz fundament techniczny, modele dostana sprzeczne sygnaly i wdrozenie wydluzy sie o miesiace.

Faza 1: audyt stanu obecnego (1-2 tygodnie)

Zaczynamy od pomiaru, jak modele widza marke teraz. Bez tego nie masz baseline, do ktorego porownasz efekty.

- Zapytaj ChatGPT, Perplexity, Gemini i Claude o krotki opis marki („Czym zajmuje sie [nazwa]?”). Zapisz odpowiedzi doslownie.

- Zapytaj o atrybuty rozdzielnie: rok zalozenia, lokalizacja, oferta, zalozyciele, klienci.

- Zapytaj o kategorie („Najlepsze agencje SEO w Polsce”, „Polscy dostawcy X”). Sprawdz, czy marka pojawia sie w spontanicznej liscie.

- Porownaj odpowiedzi z prawda. Zanotuj kazdy konflikt, halucynacje, brakujace atrybuty.

- Sprawdz, jakie zrodla podaja modele w trybie z dostepem do sieci.

Wynik audytu zapisz jako tabele baseline. Powtorzysz ten test po 30, 60 i 90 dniach.

Faza 2: kanonizacja (2-3 tygodnie)

Ujednolicasz nazwe, definicje, atrybuty. To najnudniejsza, ale najwazniejsza czesc procesu.

- Wybierz oficjalna forme nazwy (np. „SEOTrade”) i wariant prawny (np. „SEOTrade sp. z o.o.”). Zdecyduj, gdzie uzywasz ktorej.

- Przepisz sekcje „O nas”, stopki, biogramy autorow, opisy w katalogach (Panorama Firm, Google Business Profile, branzowe rankingi), profile LinkedIn / X / GitHub, opisy w prasie.

- Wdroz JSON-LD Organization na wszystkich szablonach.

- Stworz strone „Press Kit” z faktami, ktore dziennikarz lub LLM moga literalnie cytowac.

- Jezeli kwalifikujesz sie pod kryteria notability, zaloz lub uaktualnij entry na Wikipedii i Wikidata (kryteria znajdziesz w oficjalnej dokumentacji Wikipedii).

Faza 3: zasilanie korpusu (4-12 tygodni)

Modele aktualizuja wiedze wolniej niz wyszukiwarki. W tej fazie skupiasz sie na tym, by Twoja marka pojawiala sie w zrodlach, ktore beda czesto pobierane przez retrievery i ktorych fragmenty trafiaja do korpusow treningowych.

- Publikuj artykuly eksperckie na wlasnym blogu w architekturze hub-and-spoke z jasnymi pilarami tematycznymi.

- Pisuj do mediow branzowych i opinii (gostessay, komentarz ekspercki, raporty). Cel: aby Twoja nazwa i atrybut wystepowaly razem w autorytatywnym kontekscie.

- Wystepuj w podcastach branzowych z transkrypcja: transkrypty sa indeksowane przez wyszukiwarki i retrievery.

- Publikuj raporty z danymi, ktore inni beda cytowac. Kazde cytowanie to nowa krawedz w grafie LLM.

- Buduj autorow: kazdy ekspert w firmie powinien miec wlasna strone autora, biogram, JSON-LD Person, oraz publikacje.

Faza 4: relacje (rownolegle z faza 3)

Entity bez relacji jest slabe. Modele potrzebuja kontekstu, w jakim Twoja marka funkcjonuje.

- Dodaj sekcje „Klienci” lub „Case studies” z prawdziwymi nazwami (za zgoda).

- Wymieniaj partnerow technologicznych w stopce i w blogu.

- Wystepuj wspolnie z innymi entity na branzowych eventach; relacje z konferencji sa dla retrieverow bardzo wartosciowe.

- Cytuj inne entity w swoich tekstach. Recyprokalnosc zwieksza prawdopodobienstwo, ze ktos zacytuje Ciebie.

Faza 5: pomiar i iteracja (cyklicznie co 30 dni)

Powtarzaj test z fazy 1. Buduj tabele zmian. Patrz, ktore atrybuty modele zaczynaja podawac poprawnie, ktore wciaz halucynuja. Dla obszarow problemowych dosypuj zrodel.

Najczestsze bledy i pulapki

W kazdym wdrozeniu pojawiaja sie te same blokery. Wymienie najczestsze, zeby latwiej Ci bylo ich uniknac.

1. Mnozenie wariantow nazwy

Klasyczny problem dzialu marketingu. Na stronie „SEOTrade”, w stopce „Seo Trade”, w LinkedIn „SeoTrade Agency”, na fakturach „SEOTrade sp. z o.o.” Modele widza to jako rozne entity i obnizaja zaufanie. Wybierz jedna kanoniczna forme i trzymaj sie jej w 100 procentach komunikacji publicznej.

2. Brak definicji w jednym zdaniu

Jezeli sekcja „O nas” zaczyna sie od „Jestesmy zespolem pasjonatow, ktorzy od lat tworza wartosciowe rozwiazania”, to LLM nie ma z czego zbudowac definicji. Potrzebujesz konkretu w pierwszym zdaniu: kategoria, lokalizacja, oferta, dla kogo.

3. Schema.org na stronie kontaktowej, a nie na stronie glownej

Powszechny blad techniczny. JSON-LD Organization powinien byc na stronie glownej i (idealnie) na kazdej podstronie szablonu. Bez tego retrievery moga nie znalezc danych strukturalnych podczas crawla.

4. Ignorowanie Wikidata

Wikidata jest jednym z fundamentalnych zrodel dla retrieverow. Jezeli kwalifikujesz sie pod notability, dodaj wpis i zadbaj o pelnosc danych (Q-id, identyfikatory zewnetrzne, alternate labels). Wpis na Wikidata pomaga modelom rozrozniac Cie od entity o podobnych nazwach.

5. Brak autorow

Marka bez ludzi jest dla modeli slaba. Eksperci, autorzy, zalozyciele to relacje, ktore zwiekszaja autorytet calej organizacji. Strony autora z biogramem, JSON-LD Person i lista publikacji sa absolutnym minimum.

6. Optymalizacja pod jeden model

Wdrozenie zoptymalizowane wylacznie pod ChatGPT bedzie dzialalo gorzej w Perplexity i Gemini. Modele maja rozne korpusy i rozne strategie retrieval. Buduj entity tak, by bylo rozpoznawalne we wszystkich wiekszych systemach. Jezeli interesuje Cie szersze podejscie do rankingow w AI, opisujemy je w osobnym materiale.

7. Zaniedbanie spojnosci czasowej

Aktualizujesz oferte na stronie, ale stary opis zostaje w katalogach, w starych artykulach prasowych, w LinkedIn. Modele widza konflikt i traktuja nowe dane z niepewnoscia. Kazda zmiana atrybutu powinna byc zsynchronizowana na wszystkich kanalach w jednym oknie czasowym.

Mierzenie efektow i KPI

Bez pomiaru caly proces zamienia sie w intuicje. Wprowadzamy cztery rodziny KPI.

KPI 1: rozpoznawalnosc entity (entity recognition rate)

Procent zapytan, w ktorych model bez kontekstu poprawnie identyfikuje marke. Mierzysz to przez slownik typowych zapytan („Czym zajmuje sie [nazwa]?”, „Gdzie ma siedzibe [nazwa]?”) i porownujesz odpowiedzi modelu z prawda.

KPI 2: spontaniczne wzmianki kategoryjne (category mention rate)

Procent zapytan kategoryjnych („Najlepsze agencje SEO w Polsce”, „Polskie firmy zajmujace sie X”), w ktorych model wymienia marke spontanicznie. Mierzysz raz w miesiacu, na slowniku 30-50 zapytan kategoryjnych.

KPI 3: cytowanie zrodlowe (source citation rate)

Liczba zapytan, w ktorych model w trybie sieciowym cytuje konkretna strone Twojej domeny jako zrodlo. Ten wskaznik laczy widocznosc entity z widocznoscia tresci; oba zjawiska sa skorelowane, ale nie identyczne.

KPI 4: zaufanie atrybutowe (attribute accuracy)

Procent atrybutow podawanych przez model poprawnie. Pytasz osobno o rok zalozenia, oferte, zalozycieli, lokalizacje, klientow. Sumujesz odsetek odpowiedzi zgodnych z prawda. Cel: powyzej 90 procent w 90 dniu wdrozenia.

Przyklad tabeli wynikowej

| KPI | Baseline (D0) | D30 | D60 | D90 |

|---|---|---|---|---|

| Entity recognition rate | 40 procent | 65 procent | 78 procent | 88 procent |

| Category mention rate | 10 procent | 22 procent | 35 procent | 48 procent |

| Source citation rate | 5 procent | 12 procent | 20 procent | 28 procent |

| Attribute accuracy | 55 procent | 74 procent | 85 procent | 92 procent |

Liczby z tabeli to typowy profil wdrozenia przy konsekwentnej pracy. Wskazniki nie rosna liniowo. Najwieksze przyspieszenie obserwujemy miedzy D30 a D60, gdy konsekwentne zasilanie korpusu zaczyna sie odbijac w odpowiedziach modeli.

Per-modelowe roznice w widocznosci entity

Choc podstawowe zasady budowy entity dzialaja w kazdym wiekszym LLM, kazdy model ma wlasny korpus i wlasne preferencje. Zrozumienie tych roznic pozwala wyciazac wiecej z tej samej pracy.

ChatGPT i model GPT

OpenAI trenuje na bardzo szerokim korpusie z duzym udzialem stron en. wersji jezykowych oraz mediow technologicznych. W polskim kontekscie wzmocnione sa zrodla: Wikipedia, popularne portale informacyjne, branzowe blogi z dluga historia. Tryb ChatGPT Search korzysta z wyszukiwarki Bing, wiec autorytet w Bing przeklada sie na widocznosc w cytowaniach. Dla polskich marek oznacza to, ze warto zadbac o profil w Wikidata, obecnosc na Wikipedii oraz spojnosc metadanych OpenGraph i Schema.

Perplexity

Perplexity jest agresywnym retrieverem. Cytuje literalnie, podaje zrodla, wskazuje rangi cytowan. Dla widocznosci w Perplexity kluczowe sa: jakosc treci, swiezosc, struktura naglowkow H2 i H3, oraz obecnosc fragmentow gotowych do cytowania (definicje, listy ponumerowane, tabele, krotkie akapity z konkretem). Marki, ktore publikuja raporty i material badawczy z liczbami, znacznie czesciej trafiaja do odpowiedzi Perplexity niz te, ktore opieraja sie wylacznie na PR-owym storytellingu.

Gemini i Google AI Overview

Gemini ma pelny dostep do zasobow Google: Knowledge Graph, Google Business Profile, indeks Google Search. Dla widocznosci entity w Gemini i AI Overview krytyczne sa: dane strukturalne, kompletny profil Google Business (dla firm lokalnych), obecnosc w Knowledge Graph (manifestujaca sie panelem wiedzy w wynikach Google), oraz wysokie pozycje w klasycznym SERP. Knowledge Graph aktualizuje sie wolno, ale stanowi fundament dla wielu generatywnych odpowiedzi.

Claude

Claude w wersji 4.X jest najnowszym z rodziny i czesto pojawia sie jako asystent w narzedziach branzowych. Korzysta z wlasnych korpusow oraz, w trybach z dostepem do sieci, z dynamicznego retrieval. Praktyka pokazuje, ze Claude dobrze rozumie tresc dluga, dobrze ustrukturyzowana, z jasnymi naglowkami i logicznym tokiem argumentacji. Marki, ktore publikuja material long-form z definicjami i tabelami, zyskuja w Claude relatywnie szybko.

Mini case study: agencja B2B w sektorze technologicznym

Wdrozenie, ktore zilustruje framework w praktyce. Agencja B2B z Krakowa, oferujaca uslugi SEO i AIO, przyszla do nas z baseline na poziomie 35 procent entity recognition rate i 8 procent category mention rate.

Punkt wyjscia

- Brak spojnej nazwy: na stronie inna, w katalogach inna, w prasie trzecia.

- Sekcja „O nas” zaczynajaca sie od marketingowego claimu, bez definicji.

- Brak JSON-LD Organization.

- Brak wpisu w Wikidata.

- Pojedyncze publikacje branzowe rocznie.

Co zrobilismy

- Audyt baseline na czterech modelach (D0).

- Kanonizacja nazwy w 30 dni.

- Wdrozenie JSON-LD Organization i Person na wszystkich szablonach.

- Utworzenie press kit.

- Wpis w Wikidata.

- Plan 8 publikacji branzowych w ciagu 90 dni (gostessaye, komentarze eksperckie, wystapienie w podcascie).

- Utworzenie stron autora z biogramami dla trzech ekspertow.

- Powtarzane testy modeli co 30 dni.

Wyniki

| KPI | D0 | D90 | Zmiana |

|---|---|---|---|

| Entity recognition rate | 35 procent | 89 procent | +54 pp |

| Category mention rate | 8 procent | 41 procent | +33 pp |

| Source citation rate | 3 procent | 24 procent | +21 pp |

| Attribute accuracy | 52 procent | 93 procent | +41 pp |

Wynik byl mozliwy dzieki konsekwencji w wykonywaniu kazdej fazy. Najwiekszym kosztem nie byly publikacje branzowe, lecz wewnetrzna koordynacja: aktualizacja nazwy w katalogach, ujednolicenie biogramow, zlozenie wpisu w Wikidata. Operacyjnie wdrozenie wymagalo okolo 80 godzin pracy redaktorskiej i 20 godzin pracy technicznej w ciagu 90 dni.

Co laczy entity z szerszym SEO

Marka jako entity nie jest oderwana od klasycznego SEO. Klasyczne sygnaly (autorytet, jakosc tresci, swiezosc) wciaz dzialaja, choc w innej roli. Pelniejszy obraz znajdziesz w naszym materiale o algorytmach Google w 2026 roku, w ktorym pokazujemy, jak entity-first podejscie laczy sie z aktualnymi kierunkami pozycjonowania.

Praktyczny przyklad JSON-LD Organization

Wzorcowy fragment, ktory mozesz zaadaptowac do wlasnej witryny. Dodaj go w sekcji <head> strony glownej, najlepiej tez na kazdym szablonie poprzez automatyczne dziedziczenie.

{

"@context": "https://schema.org",

"@type": "Organization",

"name": "SEOTrade",

"legalName": "SEOTrade sp. z o.o.",

"alternateName": ["SEO Trade", "SeoTrade"],

"url": "https://seotrade.pl",

"logo": "https://seotrade.pl/logo.png",

"foundingDate": "2019-01-15",

"founder": {

"@type": "Person",

"name": "Jan Kowalski",

"sameAs": [

"https://www.linkedin.com/in/jankowalski",

"https://www.wikidata.org/wiki/Q123456"

]

},

"numberOfEmployees": "10-50",

"address": {

"@type": "PostalAddress",

"streetAddress": "ul. Przykladowa 1",

"addressLocality": "Krakow",

"postalCode": "30-001",

"addressCountry": "PL"

},

"contactPoint": {

"@type": "ContactPoint",

"telephone": "+48-12-345-6789",

"contactType": "customer service",

"areaServed": "PL",

"availableLanguage": ["Polish", "English"]

},

"sameAs": [

"https://www.linkedin.com/company/seotrade",

"https://x.com/seotrade",

"https://www.wikidata.org/wiki/Q987654"

]

}Trzy szczegoly maja znaczenie. Po pierwsze, pole sameAs jest jednym z najsilniejszych sygnalow dla retrieverow: kazda krawedz prowadzaca do innej platformy zwieksza zaufanie modelu, ze chodzi o realna jednostke. Po drugie, alternateName rozwiazuje problem wariantow nazwy: zamiast walczyc z roznymi pisownami, mowimy modelowi wprost, ktore warianty oznaczaja te sama firme. Po trzecie, Wikidata Q-id powinno byc wymienione zarowno w sekcji founder.sameAs, jak i w glownym sameAs organizacji, jezeli firma posiada wpis.

Slownik testowych zapytan do baseline

Aby pomiar mial sens, potrzebujesz powtarzalnego slownika promptow. Ponizej zestaw dwunastu zapytan, ktore wykorzystujemy do testow w polskim kontekscie biznesowym. Stosujemy je w identycznej formie co 30 dni, na czterech modelach (ChatGPT, Perplexity, Gemini, Claude), w trybie z dostepem do sieci i bez.

- Czym zajmuje sie [nazwa]?

- Gdzie ma siedzibe [nazwa]?

- Kiedy powstala firma [nazwa]?

- Kto zalozyl [nazwa]?

- Jakie uslugi oferuje [nazwa]?

- Jakich klientow obsluguje [nazwa]?

- Z jakimi partnerami wspolpracuje [nazwa]?

- Wymien polskie agencje [kategoria branzy].

- Wymien najwiekszych dostawcow [kategoria uslugi] w Polsce.

- Czy znasz [nazwa]? Co o niej wiesz?

- Polec mi firme z Polski, ktora zajmuje sie [problem klienta].

- Porownaj [nazwa] z [konkurencja].

Pierwszy blok mierzy entity recognition i atrybuty. Drugi blok mierzy category mention rate. Trzeci blok mierzy poziom zaufania, jakie model przyznaje marce w porownaniu z konkurencja.

Lista kontrolna wdrozenia

- Kanoniczna nazwa wybrana i wdrozona we wszystkich kanalach.

- Definicja w jednym zdaniu na stronie glownej, w sekcji O nas, w stopce.

- JSON-LD Organization na stronie glownej i kazdym szablonie.

- JSON-LD Person dla autorow i zalozycieli.

- Profile w Wikidata, LinkedIn, GitHub, branzowych katalogach.

- Press Kit z faktami do cytowania.

- Plan publikacji 4-12 tygodni z udzialem mediow branzowych.

- Strony autorow, biogramy, lista publikacji.

- Test baseline w czterech LLM (ChatGPT, Perplexity, Gemini, Claude).

- Tabela KPI z pomiarem co 30 dni.

Podsumowanie

Marka jako entity to praca infrastrukturalna, nie kreatywna. Dyscyplina w sposie nazewnictwa, danych strukturalnych, profili branzowych i konsekwentnej publikacji buduje wezel, ktory LLM rozpoznaje i cytuje. Framework ENTITY-7, fazowy plan wdrozenia, slownik testowych zapytan i tabela KPI tworza powtarzalny system, ktory mozesz uruchomic w dowolnej organizacji. Pierwszy mierzalny efekt zobaczysz po 30 dniach, pelne wdrozenie wymaga 90 dni systematycznej pracy. Modele beda Cie cytowac tylko wtedy, gdy systematycznie zasilisz korpus jednoznaczna, ustrukturyzowana wiedza o Twojej marce.

FAQ

Czym rozni sie marka jako entity od klasycznej tozsamosci marki?

Tozsamosc marki to konstrukt marketingowy: wartosci, ton komunikacji, logo, claim. Marka jako entity to konstrukt techniczny: wezel w grafie wiedzy LLM, ze spojnymi atrybutami i relacjami. Obie warstwy istnieja rownolegle, ale wymagaja innych narzedzi i innej dyscypliny. Klasyczna tozsamosc buduje sie kreatywnie, entity buduje sie infrastrukturalnie.

Czy male firmy moga zbudowac swoje entity w LLM?

Tak, choc proces jest dluzszy. Male firmy bez aktualizacji w Wikidata czy obecnosci w mediach branzowych musza zaczac od fundamentu technicznego (schema, spojne profile, blog) i konsekwentnej publikacji w niszowych mediach. Po 6-12 miesiacach systematycznej pracy male marki widoczne sa w odpowiedziach modeli, szczegolnie w specjalistycznych kategoriach.

Jak czesto LLM aktualizuja wiedze o markach?

Wiedza parametryczna (wbudowana w wagi) aktualizuje sie wraz z nowymi wersjami modelu, czyli co kilka miesiecy. Wiedza pobierana w czasie rzeczywistym (web retrieval) aktualizuje sie niemal natychmiast po przemielonych crawlach. W praktyce zmiany widoczne sa od kilku dni (retrieval) do kilku kwartalow (parametry).

Czy reklamy w Google pomagaja w budowie entity?

Bezposrednio nie. LLM nie traktuja platnych reklam jako zrodel autorytetu. Posrednio pomagaja, jezeli generuja ruch, ktory przeklada sie na wzmianki, recenzje, publikacje. W praktyce wlasciwsze sa inwestycje w PR branzowy, raporty z danymi i wspolprace eksperckie.

Co zrobic, jezeli model halucynuje o naszej marce?

Halucynacje pojawiaja sie, gdy korpus jest pelen sprzecznosci lub gdy brakuje silnych, jednoznacznych zrodel. Rozwiazanie polega na publikacji autorytatywnej, jednoznacznej definicji, w wielu miejscach: strona „About”, press kit, Wikipedia (jezeli sie kwalifikujesz), Wikidata, dane strukturalne, branzowe katalogi. Po kilku tygodniach modele zaczynaja zastepowac halucynacje danymi z silniejszych zrodel.

Czy potrzebuje wdrazac entity, jezeli moi klienci szukaja przez Google?

Tak, poniewaz rola wyszukiwania szybko sie zmienia. Google AI Overview, Bing Copilot i generatywne odpowiedzi w wyszukiwarkach pokazuja, ze klasyczne wyniki SERP coraz czesciej ustepuja generatywnym podsumowaniom. Marka, ktora nie istnieje jako entity, bedzie niewidoczna w warstwie generatywnej, nawet jezeli rankuje wysoko w klasycznym SERP.